AIが生み出したコンテンツは、本当に”オリジナル”と言えるのでしょうか?

もし、作成したコンテンツに著作権に関わるものが含まれていたら__。

生成AIの急速な発展が進む中、著作権侵害に関する訴訟やトラブルが世界中で相次いでいます。特に大規模言語モデル(LLM)においては、学習データに著作権保護されている書籍や音楽の歌詞、ニュース記事などが無断で含まれていたとの指摘が後を絶ちません。これにより、Anthropic(Claudeの開発元)やOpenAI(ChatGPTの提供元)、Meta(LLaMAの開発元)など、主要なAI企業が次々と著作権侵害で訴えられている状況です。

本記事では、AIと著作権の最新動向を解説しながら、「企業がどのようなリスク管理を行えばよいのか」という視点を中心にまとめています。

AIと著作権の交差点—いま何が起きているのか?

AI(人工知能)の進化は、私たちの想像をはるかに超えるスピードで加速しています。特に「大規模言語モデル(LLM)」の登場により、人間のような自然な会話や文章生成を実現する「生成AI」は、ビジネスの現場に革命的な変化をもたらしています。チャットボットによる24時間対応のカスタマーサービス、数秒で完成する記事の要約、クリエイティブな発想支援など、その活用シーンは日々拡大の一途をたどっています。

「AI業界を揺るがす著作権戦争 – あなたの作品も”無断学習”されているかもしれない」

この目覚ましい進化の影には、深刻な”影”が忍び寄っています。AIの性能を支える膨大な学習データの中には、著作権で保護された作品が無断で取り込まれている可能性が指摘されているのです。小説、新聞記事、歌詞、さらにはプロの写真家による作品まで—本来なら使用許諾が必要なコンテンツが、海賊版データとして大規模に収集され、AIの”糧”となっている実態が次々と明らかになってきました。

事実、2023年から2025年にかけて、クリエイティブ業界からAI企業への風当たりは急速に強まっています。ChatGPTで知られるOpenAI、Claudeを開発するAnthropic、Metaのオープンソース言語モデルLLaMAなど、AI業界の巨人たちが著作権侵害で次々と訴えられる事態となりました。この訴訟の波は、大手メディア企業や音楽レーベルにも広がり、AI開発と知的財産権の対立は深刻さを増す一方です。

(参考リンク: Authors sue Anthropic for copyright infringement over AI training)

AI訴訟の急増と海賊版書籍データセットの問題

AIによる著作権侵害は、まるで図書館の本を誰かが無断でコピーし、それを基に新しい本を大量生産しているようなものです。しかも、その”コピー元”には、海賊版の書籍が数多く含まれているという深刻な状況が明らかになってきました。このような事態を受け、クリエイターたちがAI企業への法的対応に乗り出しています。

大規模言語モデルと著作権侵害の関係

大規模言語モデル(LLM)は膨大なテキストデータを収集・学習することで成り立ちます。インターネット上に公開されているウェブページやブログ記事、論文、さらには書籍データなど、ありとあらゆるテキストをAIが”理解”し、パターンを抽出しているのです。これは、ちょうど人間が幼少期から多くの本を読み、言葉や表現を学んでいくプロセスに似ているでしょう。

しかし、問題は、こうしたデータの中に「著作権で保護されているコンテンツ」が含まれていた場合です。たとえば、有名な小説家の作品を無断でデータセットに入れ、そこから文体や表現を学習させることは、その作家の知的財産権を侵害する可能性があります。もし学習に使われた作品が海賊版であったり、権利処理が適切に行われていなかったりすれば、学習を行ったAI企業は「無断利用」というリスクを負うことになります。

Anthropicの訴訟例:The Pile / Books3をめぐる攻防

AI業界の新星として注目を集めるAnthropicは、高性能チャットボット「Claude」で知られる企業です。その技術力の高さは各方面から評価されていましたが、2024年8月、予期せぬ逆風に見舞われることになりました。アメリカの3人の著名作家—アンドレア・バーツ氏、チャールズ・グレーバー氏、カーク・ジョンソン氏が、著作権侵害を理由にAnthropicを相手取って訴訟を起こしたのです。

・訴状:Bartz et al. v. Anthropic, PBC

カリフォルニア北部地区連邦裁判所に持ち込まれたこの訴訟で、原告側は衝撃的な事実を指摘しています。Anthropicが「Claude」の開発に使用したデータセット「The Pile」の中に、「Books3」と呼ばれる書籍データベースが存在し、そこには無断でスキャンされた海賊版の書籍が大量に含まれていたというのです。

・The Pile

EleutherAIが無償公開する巨大言語データベース「The Pile」は、インターネットの海から集められた多様なテキストの宝庫です。ウェブサイトのコンテンツから最先端の研究論文、プログラミングコードまで、あらゆるジャンルの文章が詰め込まれた、いわば”デジタル図書館”となっています。

・Books3

「The Pile」のサブセットとして組み込まれた「Books3」は、約20万冊もの書籍データを内包する巨大なテキストコレクションです。問題は、その中に村上春樹氏やスティーヴン・キング氏など、世界的な作家たちの作品が無断で収録されていた疑いがあると指摘されています。

3名の作家たちは「Anthropicが海賊版と知りながら書籍データを収集し、Claudeの学習に使用した」と主張し、損害賠償と利用停止を要求。この訴訟の行方は、同様のデータを使用する他のAI企業にも波及する可能性があります。

(参考リンク:Bartz v. Anthropic PBC (3:24-cv-05417))

同様の訴訟に巻き込まれる企業:OpenAIやMetaなど

このような問題は「Claude」のAnthropicだけにとどまりません。

ChatGTPで知られるOpenAIやFacebook、Instagramを運営するMeta、音楽生成AI企業のSunoとUdioなど、事例を挙げればキリがないほどに生成AIの適正利用がなされなかったために訴訟問題に発展しています。

・OpenAI

OpenAIを揺るがす重要な司法判断が2024年9月、カリフォルニア州連邦裁判所から下されました。サラ・シルバーマン氏、タ・ネヒシ・コーツ氏、ポール・トレンブレイ氏ら著名作家らが起こした著作権侵害訴訟において、裁判所はOpenAIに対し、ChatGPTの学習に使用したデータの開示を命じたのです。

これらの訴訟は、AIの開発に必要な大量データ利用と、創作者の権利保護という二つの価値の折り合いをどうつけるか—その判断を迫る重要な岐路として、業界の内外から注目を集めました。2024年11月訴訟は却下となったものの、損害が立証出来た場合の損害は図りしれなかったでしょう。

・Meta(旧Facebook)が問われる企業倫理

2025年1月に、Metaの従業員が海賊版電子書籍ライブラリのLibrary Genesis(LibGen)を基にしたデータセットから著作権情報を削除したことを認める証言があったことや、開示された社内文章で、Metaでは公式にLibGenの使用を認めていたことが指摘されました。

この発覚により、Metaが著作権侵害のリスクを認識しながらもデータ収集を続けていたのではないかという疑念が広がっています。

・音楽業界でも:3大レーベルの訴訟

2024年6月、世界の音楽市場を牽引するソニーミュージック、ユニバーサル・ミュージック・グループ、ワーナーミュージックの3大レーベルが、音楽生成AI企業のSunoとUdioを相手取って、著作権侵害訴訟を起こしました。

訴訟の焦点は、これらのAIスタートアップが著作権で保護された楽曲や歌詞を無断でAIの学習に利用し、人間のアーティストと競合する楽曲を生成していた疑いです。大手レーベルは、無断使用された1曲につき最大15万ドルという高額な損害賠償を求めており、ReutersやMusicmanなど主要メディアが一斉に報じています。

これら一連の著作権訴訟は、AI開発の未来を左右する重要な転換点となりそうです。その判断は、業界全体の開発手法に大きな影響を及ぼすだけでなく、著作権法の現代化や、AI時代における新たな規制の枠組みづくりにも波及するでしょう。

テクノロジー企業各社は、この問題を通じて、イノベーションの追求と知的財産の保護という、相反する価値のバランスをどう取るべきか—その難しい課題に向き合うことになります。

(参考リンク:OpenAI to reveal secret training data in copyright case – for lawyers’ eyes only)

(参考リンク: Inside Meta’s race to beat OpenAI: ‘We need to learn how to build frontier and win this race’)

(参考リンク: 音楽生成AI相手に初訴訟、ソニーなど大手3社 著作権侵害訴え)

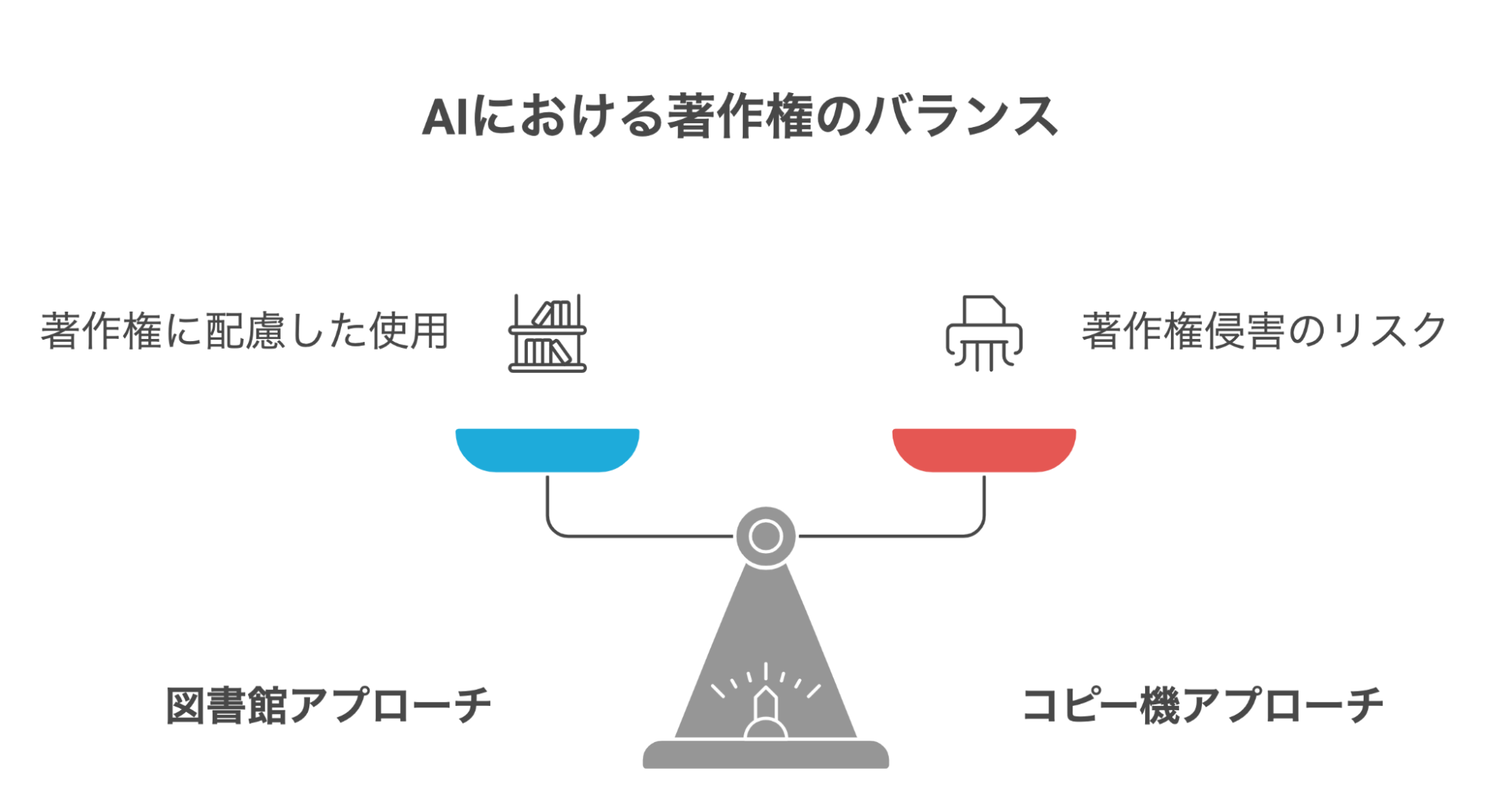

AIは「図書館」か「コピー機」か?—わかりやすい例えで見る学習データの扱い

これまでお伝えした訴訟問題からも、AIによる学習を「図書館型」と「コピー機型」に分けて考えると、その法的・倫理的グレーゾーンが見えてきます。

図書館型アプローチ

これは、実際の図書館のように、正式な許可を得た書籍を”所蔵”し、必要な時だけ”閲覧”する方式です。たとえば、学生が図書館で本を借りて読み、その知識をレポートに活かすように、AIも適切なライセンスのもと、コンテンツから学びます。引用のルールを守り、著作権者の利益を損なわない形で運用されるため、法的なリスクは限定的です。

コピー機型アプローチ

一方、こちらは図書館の本を無断でコピーし、それを大量に保管して使い回すようなものです。表向きは「本を読んでいるだけ」に見えても、実際には著作物を複製し、それを基に新しいコンテンツを生み出しているのです。まるで、教科書を丸ごとコピーして販売するような行為に近いともいえます。

重要なのは、AIによる大規模なテキスト分析そのものが違法というわけではないということです。問題となるのは、海賊版と知りながらの使用や、著作権者の許可を明らかに得ていない利用です。これは、図書館で本を読むのと、その本を無断でコピーして転売するのとの違いに似ています。

企業が直面するリスクとコスト:AI活用の裏側に潜むの落とし穴

AIの活用は企業に大きな可能性をもたらす一方で、著作権問題に関する新たなリスクも生み出しています。特に生成AIの利用において、企業は予期せぬ法的責任や経済的負担に直面する可能性があります。ここでは、その具体的なリスクとコストを解説していきます。

訴訟コスト:巨額の賠償金や和解金

もし訴訟を起こされた場合、企業には多額の賠償金や和解金がのしかかってきます。米国の事例では、AI関連の著作権侵害訴訟における和解金が1件あたり数百万ドル(数億円)規模になる可能性があるといわれています。これに加え、弁護士費用や法廷闘争にかかる時間的コストは言うまでもないでしょう。

企業イメージの失墜:ステークホルダーの信頼低下

著作権侵害に関連してネガティブなニュースが広まると、投資家や顧客から「倫理観のない企業だ」という烙印を押されかねません。ESG投資や企業のサステナビリティへの取り組みが重視される現代において、「法令順守」「社会的責任」の観点から企業姿勢が厳しく問われています。

このような状況下で著作権侵害の悪評が立てば、企業の評判は大きく傷つき、採用活動での人材確保の難しさや、取引先との契約交渉における支障など、ビジネスの様々な局面に悪影響が及ぶ可能性があります。

事業戦略の後退:AI開発計画へのブレーキ

大規模言語モデルの開発には、莫大なコストと時間がかかります。それにもかかわらず、著作権侵害のリスクが明らかになった場合、企業は学習データの再収集やAIモデルの再構築という困難な選択を迫られることになります。

この手戻りは、開発スケジュールに大きな遅延をもたらし、計画していた市場投入の時期を逃したり、提供予定だった機能を制限せざるを得なくなったりする可能性があります。結果として、ビジネスチャンスを失うだけでなく、競合他社との開発競争でも後れを取りかねません。

(参考リンク: 米NYタイムズ、OpenAIを提訴 記事流用で数千億円損害)

コンテンツ制作時に留意すべきポイント

記事制作やコピーライティングにAIを導入する企業が増える中、企業の広報・マーケティング部門が直面する新たな課題が浮上しています。ここでは、安全にAIを活用するための実務的なチェックポイントを、具体的な事例を交えながら説明します。

学習データの出所確認と権利処理

まず重要なのは、「AIツールがどのデータセットを学習しているのか」を把握することです。近年、データの透明性を重視する流れを受けて、「当社のAIは△△のデータベースを使用しています」といった形で学習データを明示するAI企業が徐々に増加しています。契約の際は、そのデータが適切な手続きを経て収集されたものか、違法コピーされた作品が含まれていないかなど、権利関係を文書で確認することがリスク管理の基本となります。

オリジナル素材・権利クリア素材の優先活用

安全なAI活用のための素材選び

海賊版データをめぐる問題が注目される中、リスクを最小限に抑えるためには、著作権が明確に管理された素材の使用が不可欠です。

具体的には、以下のような素材が推奨されます:

自社独自のコンテンツ

取材記事、撮影した写真・動画など、自社で制作した素材は最も安全な選択肢です。権利関係が明確で、利用範囲も自由にコントロールできます。

適切な利用許諾のあるフリー素材

著作権者が利用条件を明示しているフリー素材サービスのコンテンツは、その条件の範囲内で安全に活用できます。

正規の契約に基づくコンテンツ

出版社や作家と正式な契約を結び、利用許諾を得た文章データは、契約条件に従って適切に使用できます。

これらの素材を自社で適切に管理し、AIに学習させることで、著作権侵害のリスクを大幅に軽減できます。これらの素材を自社で適切に管理し、AIに学習させることで、著作権侵害のリスクを大幅に軽減できます。さらに、生成されたテキストに独自の表現や視点を加えることで、より安全で質の高いコンテンツ制作が可能になります。

(参考リンク: Terms & policies)

編集者・ライターの存在意義:AI時代でも消えない“目利き”

AIがどんなに高性能化しても、人間が持つクリエイティビティや独自性のすべてを代替できるわけではありません。特に、「文章の内容が事実に即しているか」「他人の著作権を侵害していないか」を判断する最終的なフィルターは人間の編集者やライターの役割です。

AIと人間の適切な協働のために__生成文章の適切な取り扱い

AIが生成した文章をそのまま使用することは、他者の著作物や表現を意図せず流用してしまうリスクがあります。人間の目で内容を精査し、独自の視点や新しい情報を加えた編集作業が不可欠です。

今後は、AIが生成する大量の情報から価値のある要素を見極め、読者にとって真に有用なコンテンツへと昇華させる能力が一層重要になります。AIの特性を理解しつつ、著作権などの法的知識も備えた編集者やライターは、その専門性を大いに発揮できる時代が来ると考えられます。

“守り”と“攻め”を両立するAI活用戦略:企業の実践ガイド

AIがもたらす生産性向上やコスト削減のメリットは、どの企業にとっても魅力的です。しかし、その裏にある著作権リスクを無視したまま突き進むのは危険が大きすぎます。ここでは、企業が「リスクを抑えながらAIを最大限に活用する」ための実践的なヒントをまとめます。

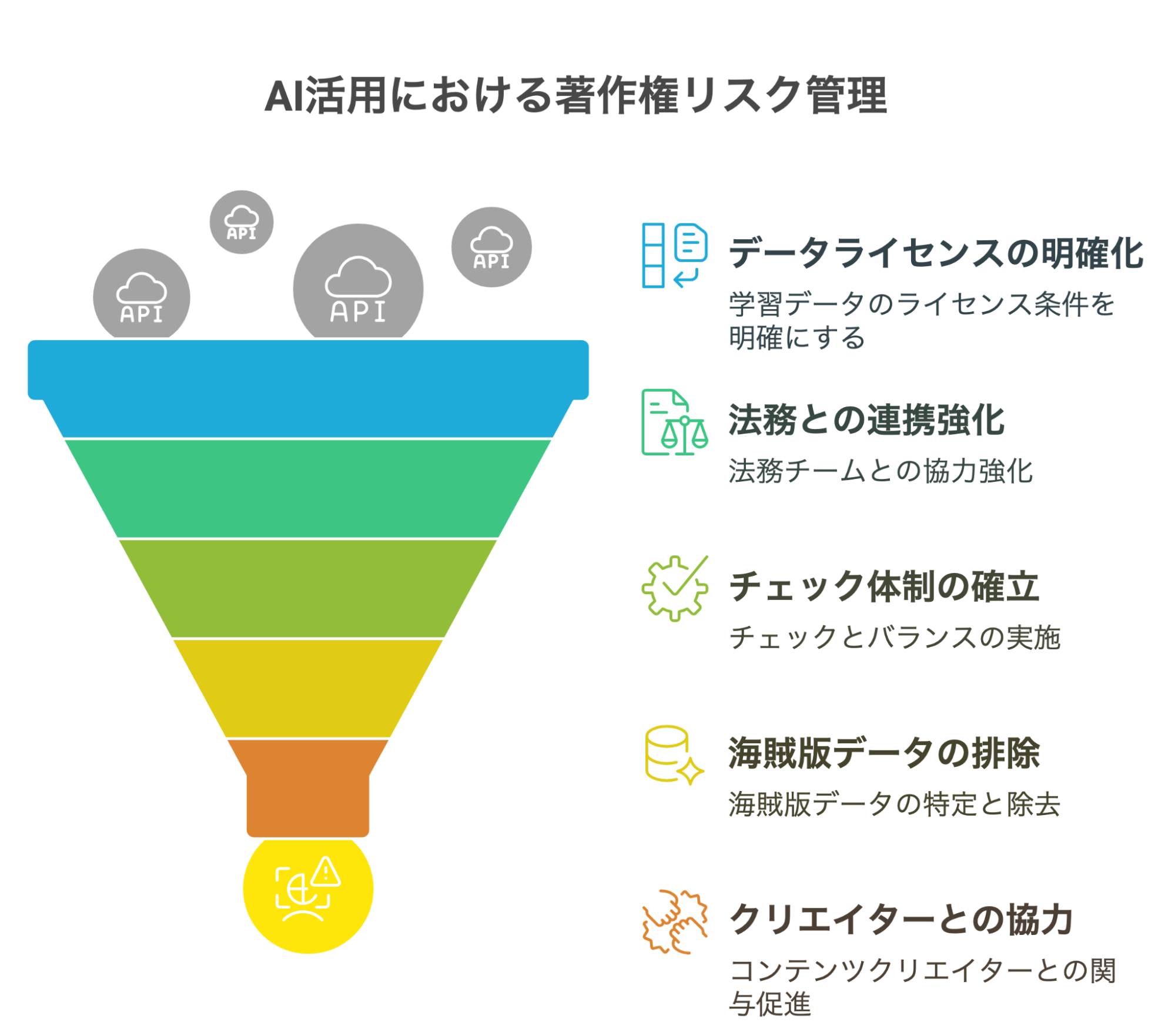

1.学習データのライセンス契約を明確化する

- AIツール提供元との契約をチェックし、「使用データの範囲」「著作権リスク対応」を確認する。

- 大手出版社や作家団体からライセンスを取得し、合法的に学習データを確保する選択肢も検討。

2. コンプライアンス担当・法務部門の連携を強化する

- 訴訟リスクを最小化するため、著作権に詳しい法務やコンプライアンス担当との連携が欠かせない。

- 自社・外注先を含めて、権利関係の監査(監視)体制をつくる。

3. チェック体制を整える

- 編集者やライターが事実確認や表現上の問題をチェックするステップを設ける。

- 万が一、著作物に抵触する可能性がある表現が見つかった場合は、即座に修正・削除できる体制を用意しておく。

4. 海賊版疑いの強いデータを徹底排除する

- 外部ツールを使う場合、「Books3」など特定の海賊版疑惑データセットを使っていないか確認。

- 必要に応じて、自社内で“クリーンデータ”を構築し、AIモデルを学習させる仕組みを導入する。

5. クリエイター・権利者との協力体制を築く

- 記事や音楽など、コンテンツの著作権を持つ当事者と積極的に対話し、相互利益を目指す。

- 著作権保護の取り組みをPRすることで、企業イメージの向上にもつなげられる。

これらの施策を通じて、AIの恩恵を享受しながら、著作権リスクを最小限に抑える体制を築くことが可能になります。

(参考リンク: 文化庁:AI と著作権に関する考え方について)

まとめ:AIと著作権—“人間の創造”とどう共存していくか

AIは私たちのビジネスや生活に今後も深く浸透していくでしょう。しかし、クリエイターたちが築き上げてきた独自の表現や知的財産が軽視されれば、文化や技術の健全な発展は望めません。

AnthropicやOpenAI、Metaを巻き込んだ一連の著作権訴訟は、テクノロジーの進歩と権利保護の難しいバランスを示しています。AI企業が巨額の投資を受けて革新的なサービスを展開する一方で、クリエイターたちは自身の作品が無断で学習データに使われる不安を抱えています。

この状況下で、企業のコンテンツ担当者に求められるのは、「リスク管理」と「積極的な活用」の両立です。

具体的には

- 著作権に配慮した学習データの選定と、違法データの排除

- 学習データの人的チェック体制の確立

- クリエイターの権利を尊重した適切なライセンス取得

AIを「創造の協力者」と位置づけ、人間はより創造的な作業に注力する—そんな協業モデルが確立されつつあります。

今後の成功の鍵は、「権利者からの信頼」「読者・顧客からの支持」「革新的なサービス開発」の3つを同時に実現することです。これは容易な課題ではありませんが、このバランスを取ることこそが、次世代のコンテンツ産業における競争力の源泉となるでしょう。

この記事を書いた人

雨輝編集部

「品質重視」「成果戦略」「価値創造」の理念をもとに媒体の垣根を超えて、"今"と"これから"読まれるコンテンツづくりを追求し続ける編プロ。記事づくりではなく、メディア戦略から、創造性に富んだ企画、最新のSEO対策、AI時代に適したマーケティングまで幅広い範囲で企業をサポートしています。